Zero Trust in der Praxis: Wie Systeme reagieren, wenn etwas schiefgeht

Die meisten Diskussionen über Sicherheit konzentrieren sich darauf, Angreifer draußen zu halten. Weit seltener wird gefragt, was passiert, nachdem etwas schiefgegangen ist. Zero Trust zielt nicht darauf ab, jedes Versagen zu verhindern. Es geht darum, Systeme so zu entwerfen, dass sie stabil bleiben, wenn Unsicherheit auftritt.

Sicherheitsdiskussionen beginnen meist an der Peripherie. Der Fokus liegt darauf, Angriffe zu verhindern, die äußere Hülle eines Systems zu härten und die Wahrscheinlichkeit einer ersten Kompromittierung zu reduzieren. Firewalls, Authentifizierungsmechanismen, verschlüsselte Verbindungen und Zugriffskontrollen dominieren das Bild. All das ist notwendig, doch es umgeht stillschweigend eine unbequeme Frage: Was geschieht, wenn trotzdem etwas versagt?

Die Erfahrung zeigt, dass Fehler keine Ausnahme sind. Zugangsdaten gelangen nach außen, Konfigurationen driften, Abhängigkeiten ändern sich, und Systeme entwickeln sich schneller als ihre ursprünglichen Annahmen. In realen Umgebungen ist nicht die Frage, ob etwas schiefgeht, sondern wann. Entscheidend ist nicht der erste Fehler selbst, sondern wie das System reagiert, nachdem dieser Fehler eingetreten ist.

Hier wird der Unterschied zwischen klassischen Architekturen und Zero-Trust-Denken sichtbar. Nicht als Schlagwort und nicht als einzelnes Produkt, sondern als grundlegend anderes Verhalten eines Systems unter Unsicherheit.

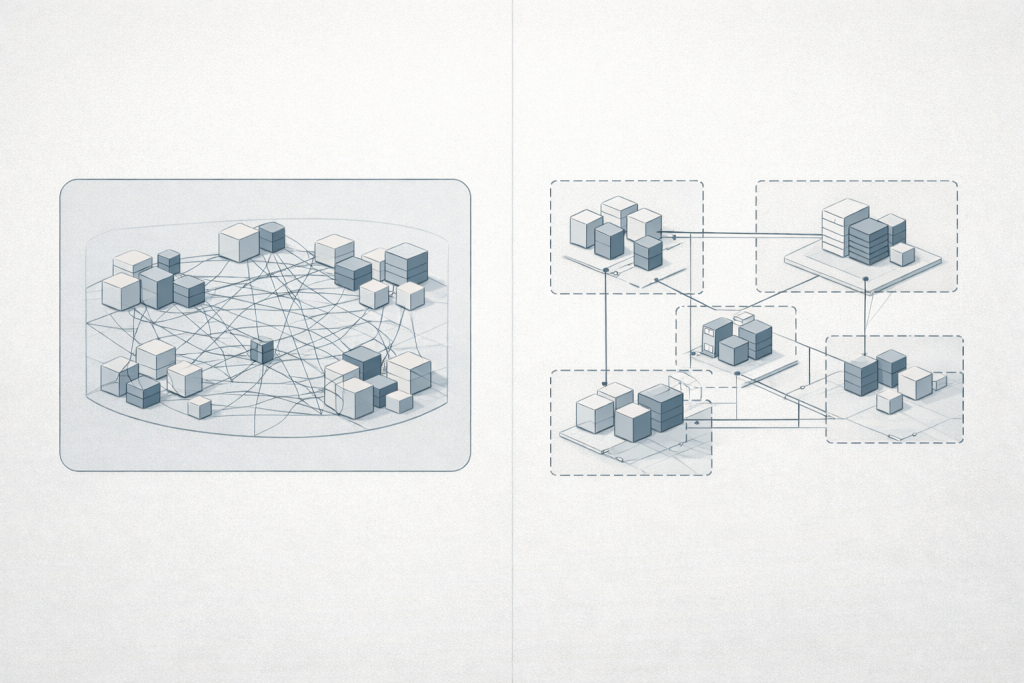

Zwei Arten, über Vertrauen nachzudenken

Traditionelle Systeme beruhen meist auf einer einfachen Annahme: Die Gefahr befindet sich außerhalb, die Sicherheit im Inneren. Sobald eine Anfrage eine Grenze überschritten hat – etwa nach einer VPN-Verbindung, einer erfolgreichen Authentifizierung oder dem Eintritt in ein internes Netzwerk -, gilt sie weitgehend als vertrauenswürdig. Das System geht davon aus, dass interne Vorgänge überwiegend harmlos sind und dass zusätzliche Prüfungen lediglich verlangsamen würden.

Zero Trust setzt an einem anderen Punkt an. Es geht davon aus, dass der Ort allein keine Bedeutung hat und dass eine zuvor akzeptierte Anfrage nicht automatisch die nächste rechtfertigt. Vertrauen ist kein dauerhafter Zustand. Es ist eine Entscheidung, die immer wieder neu getroffen wird – basierend auf Kontext, Zweck und beobachtetem Verhalten.

Diese Unterscheidung mag abstrakt klingen, wird aber in dem Moment sehr konkret, in dem etwas schiefgeht.

Ein realistischer Ausgangspunkt: Eine kompromittierte Zugangsdaten

Betrachten wir eine technisch unspektakuläre Situation. Ein Angreifer erlangt Zugriff auf eine einzelne Zugangsdaten. Das kann ein in einer Anwendung eingebetteter API-Schlüssel sein, ein Service-Account-Token in einem Kubernetes-Cluster oder ein Benutzerkonto mit eingeschränkten Rechten. Dafür sind weder außergewöhnliche Fähigkeiten noch seltene Schwachstellen erforderlich. Zugangsdaten gelangen über Logs, Backups, Fehlkonfigurationen und alltägliche Betriebsfehler nach außen.

Zu diesem Zeitpunkt ist der Vorfall noch klein. Ein Einstiegspunkt, eine Identität, ein erster Halt. Was danach geschieht, hängt vollständig davon ab, wie das System darauf ausgelegt ist zu reagieren.

Was in einer traditionellen Architektur geschieht

In einer konventionellen Umgebung wird diese Zugangsdaten im Wesentlichen als gültig akzeptiert. Ist sie korrekt, erlaubt das System alle Aktionen, die mit ihr verknüpft sind. Diese Berechtigungen sind häufig weiter gefasst als strikt notwendig – einst vergeben, um Abläufe zu vereinfachen, und später selten hinterfragt. Mit der Zeit werden sie Teil der angenommenen Normalität des Systems.

Ist der Angreifer einmal im Inneren, ist Bewegung oft unkompliziert. Interne Dienste kommunizieren miteinander, weil sie dasselbe Netzwerk oder denselben Cluster teilen. Datenbanken akzeptieren Verbindungen, weil sie Anfragen aus dem Inneren vertrauen. Überwachungssysteme protokollieren Aktivitäten, doch das System selbst verhält sich so, als wäre nichts Ungewöhnliches geschehen.

Aus Sicht des Angreifers ist dies eine Umgebung, die Geduld belohnt. Es gibt Zeit, um zu erkunden, zu testen, welche Verbindungen funktionieren, und zu beobachten, wie Komponenten zusammenspielen. Fortschritt erfordert kein Überwinden neuer Schutzmechanismen, sondern lediglich das Nutzen der Pfade, die das System bereits bereitstellt. Alles wirkt normal, weil es technisch gesehen auch normal ist.

Das prägende Merkmal ist die Kontinuität des Vertrauens. Einmal gewährt, bleibt es meist bestehen.

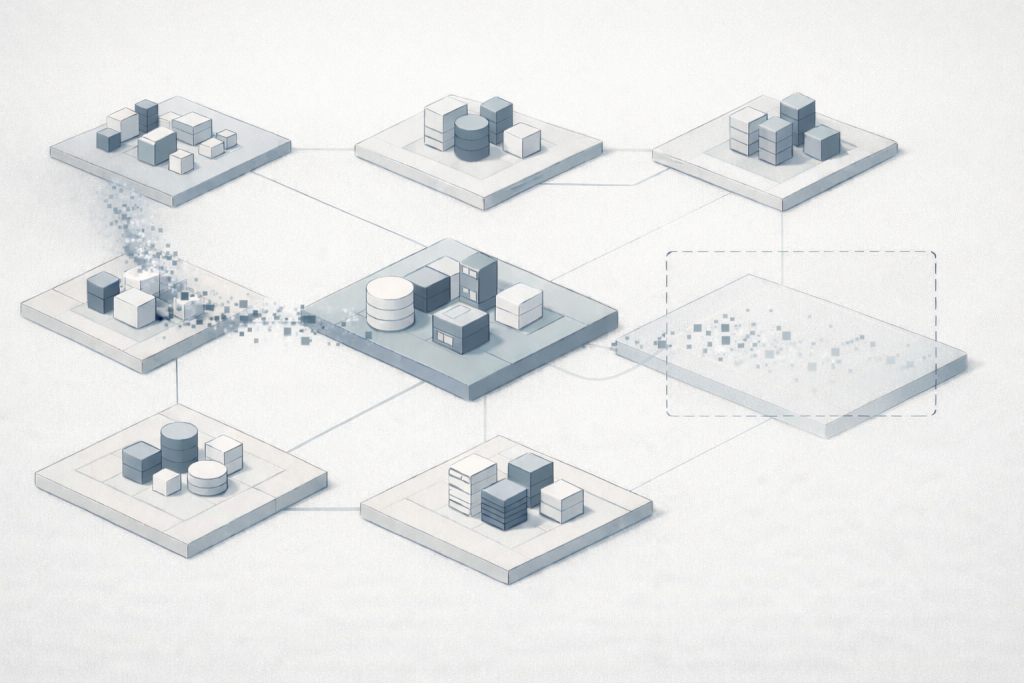

Zero Trust beginnt nach dem ersten Fehler

Zero Trust verspricht nicht, das anfängliche Leck von Zugangsdaten zu verhindern. Es behauptet nicht, menschliche Fehler oder Konfigurationsabweichungen zu eliminieren. Sein Wert zeigt sich erst nach dem ersten Versagen.

In einem Zero-Trust-orientierten System öffnet eine kompromittierte Identität nicht automatisch einen breiten Zugriff. Jede Anfrage, die mit dieser Identität gestellt wird, wird im Kontext bewertet. Das System fragt nicht nur, wer die Anfrage stellt, sondern auch, was angefordert wird, wohin sie gerichtet ist und ob dieses Verhalten dem erwarteten Muster entspricht.

Existiert für diese Kombination keine explizite Erlaubnis, schlägt die Anfrage fehl. Nicht weil ein Angriff erkannt wurde, sondern weil keine Rechtfertigung vorliegt. Fortschritt wird bedingt statt automatisch.

Diese scheinbar kleine Verschiebung hat weitreichende Folgen. Der Handlungsspielraum des Angreifers verengt sich schnell. Anstelle offener Erkundung trifft er auf Grenzen, die durch Zweck, Zeit und Umfang definiert sind.

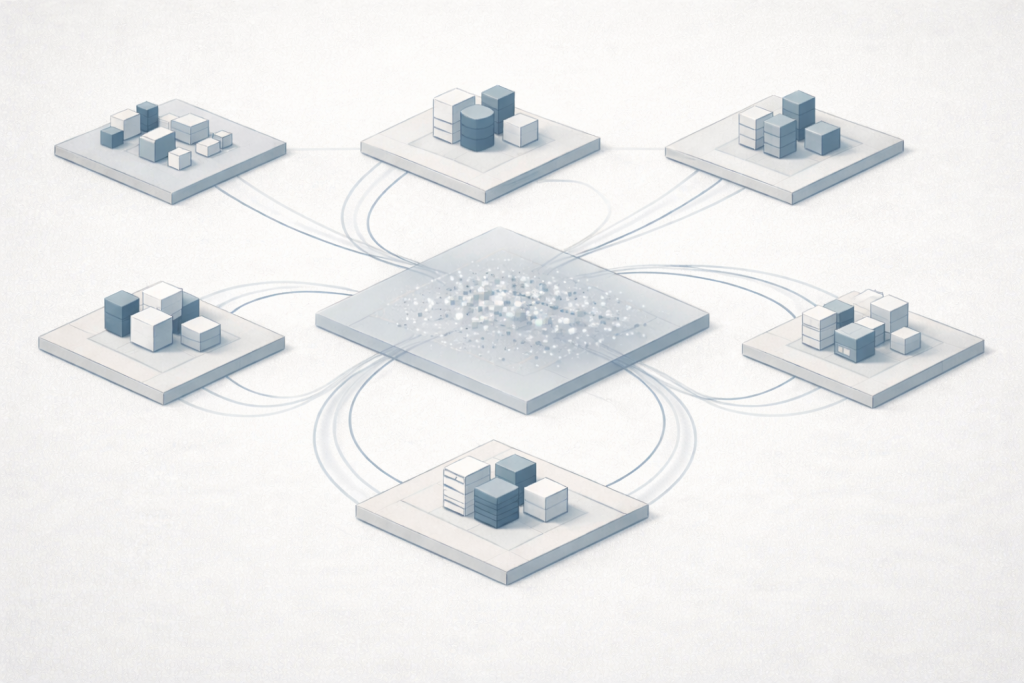

Wenn Beobachtung das Verhalten verändert

Ein zentraler Unterschied zwischen beiden Modellen liegt darin, wie Systeme auf Auffälligkeiten reagieren. In traditionellen Umgebungen werden ungewöhnliche Aktivitäten häufig protokolliert und später analysiert. Logs werden geschrieben, Alarme können ausgelöst werden, doch das operative Verhalten des Systems bleibt unverändert.

Zero Trust behandelt Beobachtung als Eingabe, nicht nur als Beleg. Wenn Überwachungssysteme – häufig zentrale Log- und Event-Sammler wie SIEM-Plattformen – Verhaltensweisen erkennen, die von etablierten Mustern abweichen, fließt diese Information zurück in die Durchsetzung.

IF service=backend AND

request_rate > baseline*5 AND

destination not in allowed_service_map

THEN

action = "tighten_policy_for_source"Dafür ist keine perfekte Gewissheit erforderlich. Das System muss das Verhalten nicht als bösartig klassifizieren. Es genügt, Unsicherheit zu erkennen. Nimmt die Unsicherheit zu, nimmt das Vertrauen ab.

Praktisch äußert sich dies häufig auf der Netzebene. Verkehr aus einer Quelle, die sich unerwartet verhält, wird auf einen kleineren Zielkreis beschränkt. Verbindungen, die technisch möglich waren, sind nicht mehr erlaubt, sofern sie nicht ausdrücklich benötigt werden. Das System passt sich an und verschärft seine Haltung ohne menschliches Eingreifen.

Im Gegensatz zu klassischen Setups, in denen Auffälligkeiten neben unverändertem Zugriff bestehen, erlaubt Zero Trust, dass Beobachtung das Systemverhalten in Echtzeit formt.

Wo Container den Unterschied sichtbar machen

apiVersion: apps/v1

kind: Deployment

metadata:

name: example-app

spec:

replicas: 2

selector:

matchLabels:

app: example-app

template:

metadata:

labels:

app: example-app

spec:

automountServiceAccountToken: false

containers:

- name: app

image: example/app:1.0.0

securityContext:

readOnlyRootFilesystem: true

runAsNonRoot: true

allowPrivilegeEscalation: falseKubernetes-Umgebungen machen diesen Unterschied besonders deutlich, weil Vertrauen direkt in Konfiguration übersetzt wird. Kubernetes selbst ist keine Zero-Trust-Plattform, stellt aber die Mechanismen bereit, um Zero-Trust-Prinzipien umzusetzen – oder zu ignorieren.

Betrachten wir, was geschieht, wenn ein Angreifer Zugriff auf einen laufenden Container erhält.

In vielen Standardkonfigurationen ist das Dateisystem eines Containers schreibbar. Prozesse laufen mit erhöhten Rechten innerhalb des Containers. Der Netzwerkverkehr zwischen Pods ist uneingeschränkt. Service-Accounts gewähren automatisch Zugriff auf die Kubernetes-API. Aus Sicherheitssicht spiegelt dies dieselbe Annahme wider wie in traditionellen Systemen: Ist man einmal im Inneren, gilt die Umgebung weitgehend als vertrauenswürdig.

Ein Zero-Trust-Ansatz behandelt dies anders.

Wird das Root-Dateisystem eines Containers schreibgeschützt eingebunden, geht das System nicht mehr davon aus, dass der Prozess seine eigene Umgebung verändern darf. Selbst wenn ein Angreifer Code im Container ausführt, kann er keine zusätzlichen Werkzeuge installieren, keine Anwendungsdateien verändern und keine Persistenz etablieren. Alles, was er tut, existiert nur im Speicher und verschwindet beim Neustart des Pods.

Das Ausführen von Containern als Nicht-Root-Benutzer verstärkt diese Grenze. Der Prozess wird als Anwendung behandelt, nicht als Betriebssystem. Viele gängige Ausnutzungstechniken scheitern schlicht, weil die dafür erforderlichen Rechte fehlen.

Netzwerkrichtlinien fügen eine weitere Ebene hinzu. Anstatt anzunehmen, dass jeder Pod mit jedem anderen kommunizieren darf, wird Kommunikation nur dort explizit erlaubt, wo sie erforderlich ist. Ein kompromittierter Pod wird nicht zum Sprungbrett für den gesamten Cluster. Er wird zu einem isolierten Endpunkt mit begrenzter Reichweite.

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: backend-ingress-from-frontend

spec:

podSelector:

matchLabels:

app: backend

policyTypes:

- Ingress

ingress:

- from:

- podSelector:

matchLabels:

app: frontend

ports:

- protocol: TCP

port: 8080

Die Einschränkung von Netzwerkpfaden reicht oft aus, um laterale Bewegungen zwischen Diensten zu unterbinden. Sie adressiert jedoch nicht einen weiteren häufigen Eskalationspfad: den Zugriff auf die Kontrollelemente selbst. In Kubernetes-Umgebungen bedeutet dies in der Regel die Kubernetes-API. Kann sich ein kompromittierter Pod gegenüber dem API-Server authentifizieren, reicht Netzisolierung allein nicht mehr aus. Der Angreifer kann beginnen, Ressourcen aufzulisten, Konfigurationen zu lesen oder neue Workloads zu erstellen.

Aus diesem Grund reicht Zero-Trust-Denken über den Dienst-zu-Dienst-Verkehr hinaus und bezieht Identität von Workloads sowie den Zugriff auf die Kontrollelemente ein.

apiVersion: v1

kind: Pod

metadata:

name: job-no-k8s-api

spec:

automountServiceAccountToken: false

containers:

- name: job

image: example/job:1.0.0

securityContext:

runAsNonRoot: true

readOnlyRootFilesystem: trueAuch der Zugriff auf die Kubernetes-API selbst wird vorsichtig behandelt. Pods, die nicht mit der Kontrollebene interagieren müssen, erhalten keine entsprechenden Zugangsdaten. Damit wird einer der häufigsten Eskalationspfade vollständig entfernt.

Keine dieser Maßnahmen macht Angriffe unmöglich. Sie machen sie begrenzt.

Die Form des Risikos verändern

Die wichtigste Wirkung von Zero Trust ist nicht Prävention, sondern Transformation. In einer traditionellen Architektur kann ein einzelner Fehler einen breiten und dauerhaften Missbrauchspfad öffnen. In einem Zero-Trust-orientierten System führt derselbe Fehler zu einer engen, temporären und fragilen Gelegenheit.

Aus Sicht des Angreifers wird die Umgebung feindlich gegenüber langsamem, methodischem Vorgehen. Zugriffe laufen ab. Routen werden blockiert. Handlungen, die vom erwarteten Verhalten abweichen, verkleinern statt erweitern den Handlungsspielraum. Was eine stille Erkundung hätte sein können, wird zu einem Wettlauf gegen Zeit und Sichtbarkeit.

Dies ist keine Garantie für Sicherheit. Es ist eine Veränderung der Dynamik.

Ein ehrliches Fazit

Zero Trust beseitigt keine Sicherheitsvorfälle. Es ersetzt nicht sorgfältige Architektur oder disziplinierten Betrieb. Es verspricht weder perfekte Erkennung noch absolute Kontrolle. Was es bietet, ist eine andere Standardreaktion auf Fehler.

Traditionelle Systeme neigen dazu, Vertrauen zu bewahren, solange ihnen nichts anderes signalisiert wird. Zero-Trust-Systeme verhalten sich umgekehrt. Wenn Gewissheit schwindet, zieht sich Vertrauen zurück.

In der Praxis entscheidet dieser Unterschied häufig darüber, ob ein Vorfall eine begrenzte Störung bleibt oder zu einem systemischen Versagen anwächst. Nicht weil Zero Trust magisch wäre, sondern weil es das Systemverhalten an die Realität anpasst, dass komplexe Systeme scheitern – und dass Resilienz damit beginnt, wie sie darauf reagieren.